УДК 159.942; 612.78; 81-13; 801; 53.8; 5309

Зиновьева Елена Иннокентьевна – федеральное государственное бюджетное образовательное учреждение высшего образования «Санкт-Петербургский государственный университет», филологический факультет, кафедра русского языка как иностранного и методики его преподавания, профессор, доктор филологических наук, Санкт-Петербург, Россия.

E-mail: e.i.zinovieva@spbu.ru

199134, Россия, Санкт-Петербург, Университетская наб., 11,

тел: +7 (921) 995-46-40.

Кузнецов Юрий Александрович – федеральное государственное бюджетное образовательное учреждение высшего образования «Санкт-Петербургский государственный университет», филологический факультет, кафедра русского языка как иностранного и методики его преподавания, доцент, кандидат филологических наук, Санкт-Петербург, Россия.

E-mail: rki1@yandex.ru

199134, Россия, Санкт-Петербург, Университетская наб., 11,

тел: +7 (911) 722-91-90.

Шахматова Марина Алексеевна – федеральное государственное бюджетное образовательное учреждение высшего образования «Санкт-Петербургский государственный университет», филологический факультет, кафедра русского языка как иностранного и методики его преподавания, доцент, кандидат филологических наук, Санкт-Петербург, Россия.

E-mail: shahmarina@mail.ru

199134, Россия, Санкт-Петербург, Университетская наб., 11,

тел: +7 (911) 973-09-92.

Бакшеева Юлия Витальевна – федеральное государственное автономное образовательное учреждение высшего образования «Санкт-Петербургский государственный университет аэрокосмического приборостроения», кафедра радиотехнических систем, доцент, кандидат технических наук, Санкт-Петербург, Россия.

E-mail: baksheyeva@rambler.ru

190000, Россия, Санкт-Петербург, ул. Большая Морская, 67,

тел: +7 (921) 935-29-18.

Данилова Ирина Михайловна – Федеральное государственное предприятие «Всероссийский научно-исследовательский институт метрологии им. Д. И. Менделеева», лаборатория метрологического обеспечения компьютеризированных датчиков и измерительных систем, инженер 1-ой категории, Санкт-Петербург, Россия.

E-mail: danilova@vniim.ru.

190005, Россия, Санкт-Петербург, Московский пр., д. 19,

тел: +7 (911) 991-22-85.

Сапожникова Ксения Всеволодовна – Федеральное государственное предприятие «Всероссийский научно-исследовательский институт метрологии им. Д. И. Менделеева», лаборатория метрологического обеспечения компьютеризированных датчиков и измерительных систем, заместитель руководителя лаборатории, Санкт-Петербург, Россия.

E-mail: k.v.s@vniim.ru

190005, Россия, Санкт-Петербург, Московский пр., д. 19,

тел: +7 (921) 306-61-26.

Тайманов Роальд Евгеньевич – Федеральное государственное предприятие «Всероссийский научно-исследовательский институт метрологии им. Д. И. Менделеева», лаборатория метрологического обеспечения компьютеризированных датчиков и измерительных систем, руководитель лаборатории, Санкт-Петербург, Россия.

E-mail: taymanov@vniim.ru

190005, Россия, Санкт-Петербург, Московский пр., д. 19,

тел: +7 (812) 948-54-61.

Авторское резюме

Задача исследования: Рассмотрена возможность использования разработанной ранее модели измерения эмоций в музыке для автоматического распознавания эмоций в речи.

Состояние вопроса: В плане просодических (интонационных и связанных с акцентами) аспектов проявления и восприятия эмоций, лингвистами ведутся исследования как в области синтеза речи по технологиям преобразования текста в речь, так и в области разработки методов распознавания эмоций в звучащей речи. Подавляющее большинство известных работ использует экспертные оценки, причем используемые модели не опираются на «механизм» формирования эмоций. Результаты этих работ не позволяют учитывать интонации при автоматическом переводе речи с одного языка на другой и облегчить обучение иностранным языкам.

Цель исследования: Целью данной работы является обоснование метода распознавания эмоций, передаваемых при произнесении отдельных слов русского языка, с использованием модели измерений, отражающей «механизм» возникновения эмоций при прослушивании музыки.

Результаты: С использованием модели измерения эмоций, предложенной ранее, проведены эксперименты по распознаванию положительной и отрицательной эмоциональной окраски при произнесении слова в различных фразах. Выявлены маркеры, позволяющие автоматически распознавать эмоции в речи по результатам анализа инфранизкочастотного спектра нелинейно преобразованных звучаний ее фрагментов.

Область применения результатов: Возможность измерения эмоций в звучащей речи на основе их объективной количественной оценки и распознавания открывает в лингвистике новые перспективы учета интонаций при автоматическом переводе речи с одного языка на другой, а также способствует облегчению процесса обучения иностранным языкам, ораторскому искусству, актерскому мастерству и культуре речи.

Выводы: Модель измерения эмоций, отражающая «механизм» их формирования, может быть эффективно использована в области лингвистики.

Ключевые слова: измерение; лингвистика; распознавание эмоций в звучащей речи; модель измерений; нелинейное преобразование звучаний.

Metrological Approach to Emotion Recognition in Sounding Speech

Zinovieva Elena Innokentievna – Saint Petersburg State University, Faculty of Philology, Department of Russian as a Foreign Language and Methodology of its Teaching, Professor, Doctor of Letters, Saint Petersburg, Russia.

E-mail: e.i.zinovieva@spbu.ru

11, Universitetskaya emb., Saint Petersburg, 199134, Russia,

tel: +7 (921) 995-46-40.

Kuznetsov Yuri Aleksandrovich – Saint Petersburg State University, Faculty of Philology, Department of Russian as a Foreign Language and Methodology of its Teaching, Associate Professor, Ph. D. (Philology), Saint Petersburg, Russia.

E-mail: rki1@yandex.ru

11, Universitetskaya emb., Saint Petersburg, 199134, Russia,

tel: +7 (911) 722-91-90.

Shakhmatova Marina Alekseyevna – Saint Petersburg State University, Faculty of Philology, Department of Russian as a Foreign Language and Methodology of its Teaching, Associate Professor, Ph. D. (Philology), Saint Petersburg, Russia.

E-mail: shahmarina@mail.ru

11, Universitetskaya emb., Saint Petersburg, 199134, Russia,

tel: +7 (911) 973-09-92.

Baksheeva Yuliya Vitalievna – Saint Petersburg State University of Aerospace Instrumentation, Department of Radio Engineering Systems, Associate Professor, PhD (technical sciences), Saint Petersburg, Russia.

E-mail: baksheyeva@rambler.ru

67, Bolshaya Morskaya st., Saint Petersburg, 190000, Russia,

tel: +7 (921) 935-29-18.

Danilova Irina Mikhailovna – D. I. Mendeleyev Institute for Metrology, Laboratory for Metrological Assurance of Computerized Sensors and Measuring Systems, 1st category engineer, Saint Petersburg, Russia.

E-mail: danilova@vniim.ru

19, Moskovsky pr., Saint Petersburg, 190005, Russia,

tel: +7 (911) 991-22-856.

Sapozhnikova Kseniya Vsevolodovna – D. I. Mendeleyev Institute for Metrology, Laboratory for Metrological Assurance of Computerized Sensors and Measuring Systems, Deputy head of laboratory, Saint Petersburg, Russia.

E-mail: k.v.s@vniim.ru

19, Moskovsky pr., Saint Petersburg, 190005, Russia,

tel: +7 (812) 306-61-26.

Taymanov Roald Evgenievich – D. I. Mendeleyev Institute for Metrology, Laboratory for Metrological Assurance of Computerized Sensors and Measuring Systems, Head of laboratory, Saint Petersburg, Russia.

E-mail: taymanov@vniim.ru

19, Moskovsky pr., Saint Petersburg, 190005, Russia,

tel: +7 (812) 948-54-61.

Abstract

Problem: The authors of the paper consider the possibility of using the emotion measurement model developed earlier with regard to music for automatic recognizing emotions in speech.

Background: In terms of prosodic (referred to intonations and accents) aspects of manifestation and perception of emotions, linguists conduct studies both in the field of speech synthesis based on text-to-speech technologies and in that of developing methods for recognizing emotions in sounding speech. The great majority of publications apply expert estimations, but the models used do not rely upon the “mechanism” for emotion formation. The results of these studies are not helpful in considering the intonations of speech being automatically interpreted to another language and do not lead to facilitating foreign languages learning.

Purpose: The purpose of this study is to justify the method of recognizing emotions transmitted when pronouncing certain words of the Russian language, using the measurement model that reflects the “mechanism” of emotion generation when listening to music.

Results: Applying the emotion measurement model proposed earlier, several experiments have been conducted to produce positive and negative emotional effect when pronouncing a word in various phrases. Revealed speech fragment markers enable automatic recognition of speech emotions using the results of the infra-low-frequency spectrum analysis of nonlinearly converted sounds.

Research implications: The possibility to measure emotions in sounding speech based on their objective quantification and recognition leads to new prospects in linguistics for taking into account intonations in the automatic interpretation of speech, as well as for contributing to foreign languages, oratory, acting skills, and culture of speech learning.

Conclusion: The emotions measurement model reflecting the “mechanism” of their formation can be efficiently used in the linguistics sphere.

Keywords: measurement; music perception; emotions; measurement model; nonlinear conversion of sound ensembles.

Введение

Анализ происхождения эмоций и их развития в процессе эволюции живых существ привел к представлению об эмоции как о многопараметрической величине, определяемой частотами и амплитудами одной или нескольких нейрофизиологических реакций, именуемых эмоциогенными. Именно эти реакции вызывают переход к состоянию, которое позволяет идентифицировать характер эмоции по ощущению или поведению субъекта [27] – крику от ужаса, удивленному взгляду, смеху и т. д.

Внешние проявления эмоций сформировались в процессе эволюции в качестве древнейшего языка, с помощью которого другим членам популяции рефлекторно, например, посредством движения тела или его части, передавалась информация о появлении опасности, необычного явления, пищи и т. д., что способствовало выживанию популяции. Естественно, что ценность этой информации тем выше, чем меньше интервал времени между восприятием стимула, рождающего эмоцию, и ее внешним проявлением. По оценкам [6], для человека этот интервал составляет не менее 2,5–3,0 с. Однако длительность формирования нейрофизиологических реакций, вызывающих эмоцию, должна быть намного короче длительности последующей мышечной реакции, т. е. составлять не более 1,0–1,5 с. Поскольку при распознавании эмоций в музыке и в звучащей речи внешние проявления их восприятия слушателем для целей проводимого исследования несущественны, далее эмоцией именуется вызывающая ее эмоциогенная реакция или сформированная на соответствующем интервале их совокупность, а последовательность нескольких таких «эмоций» именуется «эмоциональным образом».

Приведенное выше представление об эмоциях дало возможность перейти к объективной количественной оценке и распознаванию ожидаемых эмоций, рождаемых музыкой, т. е. к их измерению [1; 2; 23; 26; 28–30], а полученные результаты открыли новые области исследований, связанные с анализом, воспроизведением и воздействием звуков.

К числу этих областей относятся: медицина (педиатрия, гериатрия, психиатрия и т. д.), психология (нейропсихология, педагогическая психология), музыкальная акустика и ряд других.

В педиатрии измерение эмоций (в процессе развития ребенка с первых дней после рождения) по его вокализациям, например, по звучанию плача, должно позволить на ранних стадиях диагностировать отклонения в развитии, причем как негативные, в частности, связанные с родовыми травмами, так и позитивные, позволяющие в перспективе разработать методы усиления врожденных творческих способностей.

С помощью средства измерений эмоций станет возможным объективно оценивать выразительность звучания музыкального инструмента, что в недалеком будущем откроет перспективу серийного производства инструментов, не уступающих изделиям Страдивари и Амати.

Лингвистика также нуждается в подобных методах и средствах.

Измерение эмоций, выраженных в звучании слова или фразы, создаст основу для учета интонаций при автоматическом переводе речи с одного языка на другой, а также облегчит обучение иностранным языкам.

Целью данной работы является обоснование метода распознавания эмоций, передаваемых при произнесении отдельных слов русского языка, с использованием модели измерений, отражающей «механизм» возникновения эмоций при прослушивании музыки [2; 27].

1. Основные направления исследований в области воспроизведения и распознавания эмоций в речи

Обзор зарубежных и отечественных источников показывает, что большинство исследований, связанных с эмоциями применительно к задачам лингвистики, опирается на анализ текстов. В этих исследованиях рассматриваются проблемы эмоциональной языковой картины мира, коммуникации эмоций, корреляции лексиконов эмоций различных языков мира, национально-культурная специфика выражения эмоций, сокрытие, имитация, симуляция эмоций, проблемы эмоциональности в семантике слова и т. д. [4; 8–11; 15; 16; 18–20; 22; 24] (здесь и далее ссылки носят иллюстративный, а не исчерпывающий характер).

В плане просодических (интонационных и связанных с акцентами) аспектов проявления эмоций, ведутся исследования в области:

– синтеза речи по технологиям преобразования текста в речь;

– методов распознавания эмоций в звучащей речи.

В частности, авторы [31] представляют метод преобразования текста, содержащего туристическую информацию на китайском и отчасти английском языках, в речь. Для этого предлагается в общем случае применять трехмерную модель экспертного оценивания с осями:

– ось У – «удовольствие – неудовольствие», характеризующая отличие позитивного и негативного эмоциональных состояний;

– ось В – «возбуждение – отсутствие возбуждения», которая относится к «комбинации физической активности и ментальной осторожности»;

– ось Д – «доминирование – подчинение», относящаяся к «степени управляемости» в описании экспрессивности.

Значения по каждой оси могут меняться от «1» до «-1». В конкретных текстах туристической тематики значения У и В менялись от «0» до «1». Ось Д, необходимая, согласно [31], при синтезе речи интерактивного характера, оказалась незначимой для использованного типа текстов.

В каждом предложении были выбраны эмоционально окрашенные слова. Их значения по осям У и В определялись с помощью трех экспертов.

Текст был прочитан диктором и записан. Для анализа акустических особенностей, которые ассоциируются с просодией, авторы использовали следующие характеристики:

– интонации: среднее значение, диапазон, изменение уровня (повышение – понижение);

– интенсивность: среднее значение и диапазон среднего квадратического значения энергии;

– плавность: продолжительность пауз между эмоционально окрашенными словами;

– скорость речи: количество слогов в минуту.

Были найдены отличия между выразительной и невыразительной речью по этим параметрам, а также корреляции между значениями У и В.

В результате создан алгоритм, который предназначен для преобразования нейтральной речи в выразительную согласно параметрам и значениям входного текста. (Следует заметить, что выразительность речи должна способствовать усилению ее логической аргументации. Однако при использовании предложенного в [31] алгоритма эта связь не очевидна. С этой позиции обоснование алгоритма вызывает серьезные возражения).

Авторы [21] изучают различия между 4 стилями речи, адресованной детям (диктовка и чтение сказок) и взрослым (чтение романов и политических речей) на французском языке. Рассматривались такие просодические особенности, как количество слогов на одну акцентированную и интонационную фразу, распределение ударных слогов, высота регистра, скорость артикуляции, продолжительность пауз и т. д. Найденные закономерности предназначены для адаптации синтезируемой речи к определенной группе слушателей.

Исследователи [25] рассматривают процессы восприятия речи, акустических образов и произношения посредством нейрофизиологических методов, показывая, что фонемы (минимальные смыслоразличительные единицы языка, не имеющие самостоятельного лексического или грамматического значения) обрабатываются как дискретные единицы, являющиеся уникальными продуктами их акустических и артикуляционных особенностей, несмотря на неразделенный поток речевого сигнала. При этом чувствительность к звучащей речи характерна для широкой области коры головного мозга. Чувствительность зависит как от базовых процессов, так и от процессов высокого порядка и является результатом совместной активности различных областей головного мозга.

В русле нейрофизиологического подхода в исследовании интонации работают и авторы [17]. Они исследовали межполушарные взаимоотношения при восприятии человеком различных типов интонаций русского языка. Результаты статистического анализа задержек в восприятии и ошибок испытуемых подтвердили преимущество правого полушария в восприятии эмоциональных интонаций. Восприятие предложений с различным логическим ударением осуществлялось, в большей степени, левым полушарием. Полученные данные также свидетельствуют о разной степени вовлеченности полушарий мозга человека при восприятии и анализе просодических характеристик речи у мужчин и у женщин.

Для создания алгоритмов распознавания эмоций в звучащей речи в основном используются спектрально-временные, кепстральные, амплитудно-частотные методы, методы на основе нелинейной динамики, вейвлет-анализа речевого сигнала и опорных векторов [3; 5; 13; 14].

Однако, как убедительно показано в [14], невозможно правильно распознавать и идентифицировать различные эмоции, основываясь только на одних простых спектральных характеристиках звукового сигнала.

В [12] рассматривается связь эффективности передачи эмоций в речи с акустическими и лингвистическими характеристиками. Автор, поддерживая идеи В. П. Морозова и И. А. Алдошиной, считает, что «способы выражения эмоций являются общечеловеческими, т. е. можно предположить, что существует некий единый код». При этом, поскольку «при речевом общении основной задачей является передача смыслового содержания, то эмоциональный аккомпанемент является как бы вторым планом, воспринимаемым подсознанием. Это связано с тем, что невербальные способы общения имеют более древнее эволюционное происхождение».

В [12] предлагается следующий алгоритм определения эмоционального состояния человека по речи:

– квантование и фильтрация звучания речи гребенкой из 24 фильтров;

– представление речевого сигнала в виде последовательности значений кратковременных энергетических спектров;

– определение параметров, характеризующих речевой поток;

– определение эмоции по предложенной функциональной зависимости.

К сожалению, и в этой работе обоснование эффективности предложенного алгоритма не приведено.

Созданию алгоритма распознавания эмоций в звучащей речи посвящена и статья [3]. В ней высказана мысль, что формальные критерии хотя и позволяют успешно дифференцировать отдельные эмоции по речевым образцам, не могут дать общей картины изменения текущего эмоционального состояния человека. Необходима система, достаточно полно моделирующая процесс восприятия эмоций человеком, которая учитывает совокупность разных аспектов их проявления, в том числе, в речи.

«Аппарат анализа речевого сигнала должен, хотя бы в некоторой степени, воспроизводить процессы, позволяющие нервной системе человека правильно распознавать всю гамму эмоций, т. е. необходима антропоморфная модель эмоций» (антропоморфной, по-видимому, именуется модель, отображающая реальные процессы рождения эмоций у человека). Автор предлагает 4-х-мерную структуру (вариант модели экспертного оценивания), связывает ее с результатами работ П. В. Симонова и называет антропоморфной.

Первые две ее оси определяют оценку ситуации: ось 1 – по знаку (хорошо, полезно, приятно или плохо, вредно, неприятно), ось 2 – по степени информационной определенности (уверенность – удивление), 3-я и 4-ая оси связаны с побуждением: ось 3 – притяжение, ось 4 – отвержение (оборонительная реакция), активное (агрессия) или пассивное избегание (страх).

В экспериментах [3] по распознаванию эмоций в качестве стимулов использовались слова «да» и «нет», произносимые с различной эмоциональной окраской. Даже такие короткие одноударные слова, как свидетельствует практика актерского мастерства, вполне могут адекватно и полно отражать весь спектр эмоциональных проявлений. Согласно [3], эти слова, по сравнению с другими, несут более определенное и не зависящее от контекста значение, но, в то же время, они более нейтральны и допускают больше вариантов эмоциональной окраски при их произнесении.

Для звукового фрагмента с помощью быстрого преобразования Фурье в скользящем окне со сглаживанием вычислялась последовательность мгновенных спектров мощности сигнала, показатель микро-вариативности (стандартное отклонение) амплитуды на каждой частоте, а затем определялась интегральная оценка путем усреднения последнего показателя по частоте.

Алгоритм, использованный в [3], напоминает описанный в [31].

В [3] показано, что параметры речевого сигнала хорошо согласуются с психофизиологической моделью эмоций, но отмечено, что необходимо дополнительное исследование универсальности выделенных параметров речевого сигнала по отношению к специфике голоса диктора и различным речевым высказываниям.

Согласно [3], предложенная модель антропоморфна, поскольку отражает субъективное отношение человека, и нейротропна, поскольку отражает нейронные механизмы, что позволяет количественно описать и наглядно представить изменения текущего эмоционального состояния человека.

К сожалению, из [3] неясно, что понимается в этой работе под эмоцией, какие эмоции были заложены в используемые стимулы, как происходит формирование эмоций, правомерно ли утверждение об антропоморфности предложенного алгоритма. Более поздних работ автора [3], касающихся развития этой темы, найти не удалось.

При этом нельзя не согласиться с позицией, выраженной в [3], что эффективная модель распознавания эмоций должна быть «антропоморфной» и, соответственно, отражать реальные процессы формирования эмоций.

2. Обоснование модели измерений

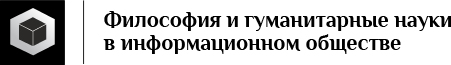

В основе первой ступени модели измерений (рис. 1), используемой при проведении исследований, лежит гипотеза авторов [2; 29] о том, что эволюционно эмоции произошли от простейших реакций первых живых существ на Земле в ответ на воздействие окружающей среды. При этом, поскольку жизнь зародилась в воде, первыми органами «общения» с внешним миром были органы осязания, а первыми воздействиями окружающего мира на организм – инфранизкочастотные (ИНЧ) колебания – в силу плотности воды как среды распространения сигнала.

Рис. 1. – Первая ступень модели измерения [2]

Древнейшим (базовым) эмоциям соответствовали рефлекторные проявления, разнообразие которых было резко ограничено временем формирования соответствующих нейрофизиологических реакций.

Выход земноводных и рептилий из воды на сушу, где плотность среды резко меньше, привел к падению чувствительности к колебаниям, важным для выживания. Однако ИНЧ колебания водной и земной поверхностей модулируют колебания воздуха в звуковом диапазоне.

Согласно предложенной гипотезе, возможность приема жизненно важных колебаний живыми существами на суше в процессе эволюции была реализована с помощью органов слуха, позволивших принимать модулированные колебания звукового диапазона, а также последующей их демодуляции в центральной нервной системе путем нелинейного преобразования. Из преобразованных колебаний стали выделяться ИНЧ комбинационные колебания, стимулирующие возникновение базовых эмоций. У млекопитающих частоты этих реакций сохранены генетически в форме частот биоритмов мозга. В процессе эволюции число базовых эмоций и связанных с ними биоритмов возросло, диапазон воспринимаемых частот колебаний, влияющих на формирование эмоций, расширился до 30–50 Гц.

Используемая в исследовании модель измерений отражает механизм возникновения эмоций и поэтому является инструментом, позволяющим не только объяснять имеющиеся феномены, но и генерировать новое научное знание.

3. Методика проведения измерительного эксперимента

Для проведения эксперимента была отобрана группа студентов филологического факультета Санкт-Петербургского государственного университета. Для всех испытуемых русский язык являлся родным.

Был подготовлен список фраз (таблица 1), характеризующихся эмоциональной окраской (положительной или отрицательной), которую нужно было передать интонационно. Участники эксперимента читали эти фразы; при этом осуществлялась запись на диктофон [7].

Таблица 1. Фразы с эмоциональной окраской, предложенные для озвучивания

|

Положительная эмоциональная окраска |

Отрицательная эмоциональная окраска |

| Удовольствие! | Удовольствие… |

| Вот это удовольствие! | Удовольствие? |

| Это же удовольствие! | Ну и удовольствие… |

| Это же настоящее удовольствие! | Это ж разве удовольствие? |

| Вот так удовольствие! | Какое же это удовольствие?…. |

| Какое это удовольствие! | Ну нет, это не удовольствие. |

| Это прямо удовольствие! | Не получил никакого удовольствия. |

| Получил огромное удовольствие! | Сомнительное удовольствие. |

| От театра я получаю огромное удовольствие. | От бесед с ним я не получаю никакого удовольствия. |

| Без сомнения, это удовольствие. | Не надейтесь, не получите от этого никакого удовольствия. |

| Не сомневайтесь: вы получите от этого большое удовольствие. | Я ем это без всякого удовольствия. |

| Я ем это с большим удовольствием. | Не возьму – это для меня сомнительное удовольствие. |

| Мне бы хотелось доставить вам удовольствие. | |

| Бери – это такое удовольствие! |

4. Методика обработки данных и обсуждение результатов

Обработка данных включала этапы, соответствующие модели измерений (рис. 1). Нелинейное преобразование проводилось путем возведения исходного аудиосигнала в степень. Полученный сигнал переводился в частотную область с помощью преобразования Фурье. При проведении исследования было принято решение отказаться от прямого анализа спектров сигналов после нелинейного преобразования. Был предложен более простой и информативный подход, предполагающий вычисление доли Р мощности, приходящейся на каждый из поддиапазонов биоритмов, в процентах относительно рассматриваемого диапазона биоритмов (от 0,6 до 40 Гц):

где f1 и f2 – границы поддиапазона биоритмов.

Первый этап анализа записей привел к выводу, что многие фразы произнесены интонационно нейтрально, а в ряде случаев, в длинных фразах с правильно выдержанной эмоциональной окраской на исследуемое слово не сделано эмоциональное ударение.

Невыразительное озвучивание нивелирует различия фраз с полярной эмоциональной окраской. Поэтому для дальнейшего анализа было отобрано около 150 фраз, произнесенных эмоционально.

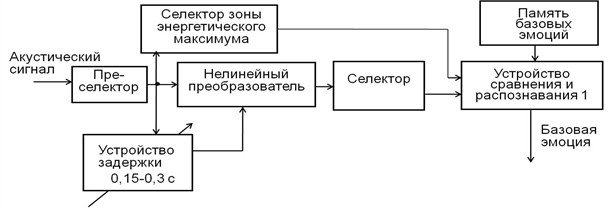

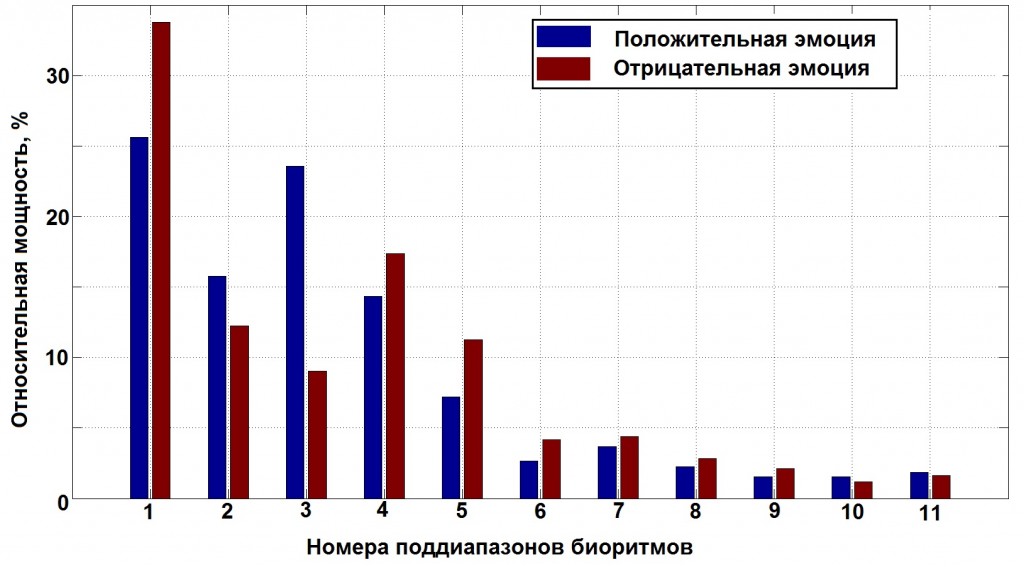

Второй этап анализа ставил целью определить, как разбивать частотную зону биоритмов на отдельные поддиапазоны, в которых следует вычислять мощность. Было проанализировано два варианта разбиения (рис. 2) при усреднении результатов по всем участникам:

– стандартное разбиение на 5 поддиапазонов: Дельта (0,6–4 Гц), Тета (4–8 Гц), Альфа (8–12 Гц), Бета-1 (12–20 Гц) и Бета-2 (20–40 Гц);

– разбиение на 11 поддиапазонов: Дельта-1 (0,6–2 Гц), Дельта-2 (2–4 Гц), Тета-1 (4–6 Гц), Тета-2 (6–8 Гц), Альфа-1 (8–10 Гц), Альфа-2 (10–12 Гц), Бета‑1_1 (12–16 Гц), Бета-1_2 (16–20 Гц), Бета-2_1 (20–25 Гц), Бета-2_2 (25–30 Гц) и Бета-2_3 (30–40 Гц).

Рис. 2. – Разбиение диапазона биоритмов на поддиапазоны

Как показал анализ, использование стандартного разбиения скрывает часть информации. Поэтому на следующих этапах исследования использовалось разбиение диапазона биоритмов на одиннадцать поддиапазонов.

Третий этап был посвящен ответу на вопрос, какими статистическими характеристиками предпочтительнее пользоваться – средним арифметическим или медианой. Такой вопрос возник из прошлого опыта работы, когда при обработке ЭЭГ испытуемых оказалось, что более адекватно экспериментальные данные можно оценивать с помощью медианы, а не среднего арифметического [28].

Анализ показал, что в данном случае существенной разницы нет. В дальнейшем в качестве статистической характеристики была использована общепринятая – среднее арифметическое.

Четвертый этап должен был дать ответ на основной вопрос: есть ли разница в полученных результатах между положительной и отрицательной эмоцией в голосе при произнесении одного и того же слова «удовольствие» (рис. 3).

Рис. 3. – Спектр средней относительной мощности ИНЧ колебаний нелинейно преобразованного звучания слова «удовольствие», произнесенного с «положительной и «отрицательной» эмоциональной окраской

Отмечено, что для звучаний с положительной эмоциональной окраской мощность в поддиапазоне Тета-1 превышает мощность в поддиапазонах Дельта-2, Тета-2 и Альфа-1, в то время как для звучаний с отрицательной эмоциональной окраской все наоборот. Поэтому отношения мощностей

![]() ,

,![]() ,

,![]() могут служить так называемыми «маркерами» – признаками, позволяющими определить знак эмоции: граничные значения маркеров больше 1 показывают, что эмоция положительна, а значения меньше 1 говорят об отрицательной эмоции.

могут служить так называемыми «маркерами» – признаками, позволяющими определить знак эмоции: граничные значения маркеров больше 1 показывают, что эмоция положительна, а значения меньше 1 говорят об отрицательной эмоции.

В ходе дальнейшего исследования были проанализированы также «сложные маркеры» – произведения указанных отношений – для выявления сочетаний, наиболее устойчиво характеризующих «знак» эмоции. При этом для повышения достоверности оценок граничные значения маркеров были выбраны следующими: для отрицательной эмоции – меньше 1, для положительной эмоции – больше 2. Расчеты показали, что в этом случае наилучший результат, представленный в таблице 2, достигается при использовании сложного маркера

Таблица 2. Сравнительный анализ эффективности маркеров эмоций

|

Маркер |

Вероятность правильного распознавания отрицательной эмоции, % |

Вероятность правильного распознавания положительной эмоции, % |

|

78 |

60 |

|

80 |

76 |

|

44 |

92 |

|

100 |

100 |

|

57 |

97 |

|

62 |

100 |

Естественно, что при выборе других граничных значений маркеров соответствующие вероятности изменятся.

Заключение

Модель измерения эмоций, отражающая «механизм» их формирования, может быть использована для исследований в области лингвистики эмоций.

Выявлены маркеры, позволяющие автоматически распознавать эмоции в речи (по результатам анализа инфранизкочастотного спектра нелинейно преобразованных звучаний ее фрагментов).

Проведенное исследование является первым шагом в направлении, имеющем значительные научные и практические перспективы. Полученные результаты открывают возможности усовершенствования методов:

– автоматического перевода – оценка эмоциональной окраски речи позволяет более точно осуществлять перевод;

– обучения иностранным языкам – становится доступной интонационная коррекция и отработка адекватной интонационной окраски речи;

– обучения ораторскому искусству, актерскому мастерству и даже культуре речи – может быть реализована система с обратной связью (аналогичная биологической обратной связи) для отработки правильной интонации с мгновенным анализом эмоциональной окраски произносимых слов и фраз.

Возможно применение рассмотренного выше подхода и в ряде других направлений, связанных с лингвистикой.

Работа выполнена при поддержке гранта РГНФ 15-04-00565.

Список литературы

1. Бакшеева Ю. В., Данилова И. М., Сапожникова К. В., Тайманов Р. Е. Метрологический подход к обоснованию нелинейного характера процесса формирования эмоций // XVIII международная научно-техническая конференция «НЕЙРОИНФОРМАТИКА-2016». − Москва. − 2016. − С. 222–231.

2. Бакшеева Ю. В, Сапожникова К. В, Тайманов Р. Е. Измерения как способ понимания языка музыки. Особенности экспериментального исследования // Философия и гуманитарные науки в информационном обществе. – 2015. – № 4. – С. 39–53. [Электронный ресурс]. – Режим доступа: http://fikio.ru/?p=1949 (дата обращения 01.09.2017).

3. Вартанов А. В. Антропоморфный метод распознавания эмоций в звучащей речи // Национальный психологический журнал. − 2013. − № 2(10). – С. 69–79.

4. Голованевский А. Л. Оценочность и ее отражение в политическом и лексикографическом дискурсах (на материале русского языка) // Филологические науки. – 2002. − № 3.− С. 78–87.

5. Горшков Ю. Г. Обработка речевых сигналов на основе вейвлетов // T-Comm: Телекоммуникации и транспорт. – 2015 .– № 2. – С. 46–53.

6. Гузиков Б. М., Альтман Я. А. Алянчикова Ю. О., Громыко Д. И., Голубев А. А. Восприятие коротких музыкальных отрывков человеком // Сенсорные системы. – 2004. − № 3. − С. 239–250.

7. Зиновьева Е. И., Кузнецов Ю. А., Шахматова М. А., Бакшеева Ю. В., Данилова И. М., Сапожникова К. В., Тайманов Р. Е. Эмоциональность языковых единиц как измеряемая величина // Международный научный семинар «Язык, музыка и компьютерные технологии». − Санкт-Петербург. − 2017. − С. 44–47.

8. Карасик В. И. Языковой круг: Личность, концепты, дискурс. – М.: Гнозис, 2004. – 390 с.

9. Маклакова Е. А. Типы семантических компонентов и аспектно-структурный подход к описанию семантики слова. – Воронеж: «Истоки», 2013. – 32 с.

10. Маклакова Е. А., Стернин И. А. Теоретические проблемы семной семасиологии. – Воронеж: «Истоки», 2013. – 277 с.

11. Попова З. Д., Стернин И. А. Семемный и семный анализ как методы семасиологии // Язык и национальное сознание. – № 12. – Воронеж: «Истоки», 2009. – С. 4–9.

12. Розалиев В. Л. Построение модели эмоций по речи человека // Известия Волгоградского государственного технического университета. – 2007. −Том: 3. − № 9 (35). – С. 65–68.

13. Романенко Р. Ю. Вейвлет-анализ речевых сигналов. Успехи современной радиоэлектроники // Зарубежная радиоэлектроника. – 2010. – № 12. – С. 51–54.

14. Сидоров К. В., Филатов Н. Н. Анализ признаков эмоционально окрашенной речи // Вестник Тверского государственного технического университета. – 2012. – № 20. – С. 26–31.

15. Тарасова О. Д. Основные направления исследования эмоций в лингвистике // Вестник МГОУ. Серия: Лингвистика. – 2015. – № 3. – С. 38–45.

16. Телия В. Н. Коннотативный аспект семантики номинативных единиц. – М.: Наука, 1986. – 143 с.

17. Черниговская Т. В., Светозарова Н. Д., Токарева Т. И., Третьяков Д. А., Озерский П. В., Стрельников К. Н. Специализация полушарий мозга в восприятии интонаций русского языка // Физиология человека. – 2000. − № 2.− С. 24–29. [Электронный ресурс]. – Режим доступа: http://www.genlingnw.ru/Staff/Chernigo/publicat/FelixFIN.pdf (дата обращения 01.09.2017).

18. Шаховский В. И. Категоризация эмоций в лексико-семантической системе языка. – Воронеж: Изд-во ВГУ, 1987. – 192 с.

19. Шаховский В. И. О лингвистике эмоций // Язык и эмоции: Сборник научных трудов / Волгоградский государственный педагогический университет. – Волгоград: Перемена, 1995. – С. 3–15.

20. Шаховский В. И. Эмоциональная / эмотивная компетенция в межкультурной коммуникации // Аксиологическая лингвистика: проблемы изучения культурных концептов и этносознания / Отв. ред. Н. А. Красавский. – Волгоград, 2002. – С. 3–10.

21. Avanzi M., Christodoulides G., Lolive D., Delais-Roussarie E., Barbot N. Towards the Adaptation of Prosodic Models for Expressive Text-To-Speech Synthesis // ISCA 2014. – Singapore. – 14–18 September 2014. DOI: 10.13140/2.1.4640.3848.

22. Avetisyan H., Bruna O., Holub J. Overview of Existing Algorithms for Emotion Classification. Uncertainties in Evaluations of Accuracies // IMEKO 2016 TC1-TC7-TC13. – IOP Publishing Journal of Physics, Conference Series 772. – 2016. DOI:10.1088/1742-6596/772/1/012039.

23. Baksheeva Yu., Bazanova O., Kostromina S., Nikolenko E., Sapozhnikova K., Taymanov R. Neurophysiological Markers of Tonalities // Ninth Triennial Conference of the European Society for the Cognitive Sciences of Music. – Manchester, UK. – 2015. – pp. 202–203.

24. Bruna O., Avetisyan H., Holub J. Emotion Models for Textual Emotion Classification // IMEKO 2016. – IOP Publishing. – Journal of Physics. – Conference Series 772. – 2016. DOI:10.1088/1742-6596/772/1/012063.

25. Rampinini A., Ricciardi E. In Favor of the Phonemic Principle: a Review of Neurophysiological and Neuroimaging Explorations // Studi & Saggi Linguistici. – 2017. – № 55 (1). – pp. 95–123. [Электронный ресурс]. – Режим доступа: https://www.researchgate.net/publication/315657311_In_Favor_of_the_Phonemic_Principle_a_Review_of_Neurophysiological_and_Neuroimaging_Explorations_In_Studi_Saggi_Linguistici_55_1_95-123 (дата обращения 01.09.2017).

26. Sapozhnikova K., Taymanov R. About a Measuring Model of Emotional Perception of Music // Proceedings of the XVII IMEKO World Congress. – Dubrovnik, Croatia. – 2003. – рр. 2049–2053.

27. Sapozhnikova K., Taymanov R., Baksheeva Iu., Kostromina S., Gnedykh D., Danilova I., Cosimi Corleto (Ed.) Metrological Approach to Measurements of Emotions Being Expected in Response to Acoustic Impacts // Proceedings of the 18th International Congress of Metrology, EDP sciences, Web of Conferences. – Paris, France. – September 19–21. – 2017. [Электронный ресурс]. – Режим доступа: https://cfmetrologie.edpsciences.org/articles/metrology/abs/2017/01/metrology_metr2017_10006/metrology_metr2017_10006.html (дата обращения 01.09.2017). DOI: 10.1051/metrology/201710006.

28. Taymanov R., Baksheeva Yu., Sapozhnikova K., Chunovkina A. Measurement Model as a Means for Studying the Process of Emotion Origination // Journal of Physics: Conference Series (JPCS). − 2016. − 772. − Art. 012036. − 6 p. [Электронный ресурс]. – Режим доступа: http://iopscience.iop.org/article/10.1088/1742-6596/772/1/012036 (дата обращения 01.09.2017). DOI: 10.1088/1742-6596/772/1/012036.

29. Taymanov R, Sapozhnikova K. Improvement of Traceability of Widely-Defined Measurements in the Field of Humanities // Measurement Science Review. – 2010. – Vol. 10. – № 3. – pp. 78–88.

30. Taymanov R., Sapozhnikova K. Measurement of Multiparametric Quantities at Perception of Sensory Information by Living Creatures // EPJ Web of Conferences. – 2014. – Vol. 77. – [Электронный ресурс]. – Режим доступа: http://www.epj-conferences.org/articles/epjconf/pdf/2014/14/epjconf_icm2014_00016.pdf (дата обращения 01.09.2017). DOI: 10.1051/epjconf/20147700016.

31. Yang H., Meng H. M., Cai L. Modeling the Acoustic Correlates of Expressive Elements in Text Genres for Expressive Text-to-Speech Synthesis // INTERSPEECH 2006 and 9th International Conference on Spoken Language Processing. INTERSPEECH 2006. – ICSLP. – Vol. 4. – 2006. – pp. 1806–1809.

References

1. Baksheeva Yu. V., Danilova I. M., Sapozhnikova K. V., Taymanov R. E. Metrological Approach to the Justification of the Nonlinear Nature of the Process of Emotions’ Formation [Metrologicheskiy podhod k obosnovaniyu nelineynogo haraktera protsessa formirovaniya emotsiy]. XVIII mezhdunarodnaya nauchno-tekhnicheskaya konferentsiya “NEYROINFORMATIKA-2016” (XVIII International Scientific-Technical Conference “NEUROINFORMATICS-2016”). Moscow, 2016, pp. 222–231.

2. Baksheeva Yu. V., Sapozhnikova K. V., Taymanov R. E. Measurement as a Way of Understanding the Language of Music. Features of Experimental Studies [Izmereniya kak sposob ponimaniya yazyka muzyki. Osobennosti eksperimentalnogo issledovaniya]. Filosofiya i gumanitarnye nauki v informatsionnom obschestve (Philosophy and Humanities in the Information Society), 2015, № 4, pp. 39–53. Available at: http://fikio.ru/?p=1949 (accessed 01 September 2017).

3. Vartanov A. V. Anthropomorphic Method of Emotion Recognition in the Speech [Antropomorfnyy metod raspoznavaniya emotsiy v zvuchaschey rechi]. Natsionalnyy psikhologicheskiy zhurnal (National Psychological Journal), 2013, No 2(10), pp. 69–79.

4. Golovanevskiy A. L. Evaluation and Its Reflection in Political and Lexicographical Discourses (in the Russian Language) [Otsenochnost i ee otrazhenie v politicheskom i leksikograficheskom diskursakh (na materiale russkogo yazyka)]. Filologicheskie nauki (Philological Sciences), 2002, № 3, pp. 78–87.

5. Gorshkov Yu. G. Processing of Speech Signals Based on Wavelet [Obrabotka rechevykh signalov na osnove veyvletov]. Telekommunikacii i transport (Telecommunications and Transport), 2015, № 2, pp. 46–53.

6. Guzikov B. M., Altman J. A., Alyanchikova Yu. O., Gromyko D. I., Goloubev A. A. Perception of Short Musical Fragments in Humans [Vospriyatie korotkikh muzykalnykh otryvkov chelovekom]. Sensornye sistemy (Sensor Systems), 2004, № 3, pp. 239–250.

7. Zinovyeva E. I., Kuznetsov Yu. A., Shahmatova M. A., Baksheeva Yu. V., Danilova I. M., Sapozhnikova K. V., Taymanov R. E. Emotionality of Language Units as the Measured Value [Emotsionalnost yazykovykh edinits kak izmeryaemaya velichina]. Mezhdunarodnyy nauchnyy seminar “Yazyk, muzyka i kompyuternye tekhnologii” (International Workshop “Language, Music and Computer Technologies”). Saint Petersburg, 2017, pp. 44–47.

8. Karasik V. I. The Language Circle: Personality, Concepts, Discourse [Yazykovoy krug: Lichnost, kontsepty, diskurs]. Moscow, Gnozis, 2004, 390 p.

9. Maklakova E. A. Types of Semantic Components and an Aspect-Structural Approach to the Description of Word Semantics. [Tipy semanticheskikh komponentov i aspektno-strukturnyy podkhod k opisaniyu semantiki slova]. Voronezh, Istoki, 2013, 32 p.

10. Maklakova E. A., Sternin I. A. Theoretical Problems of Component Semasiology [Teoreticheskie problemy semnoy semasiologii]. Voronezh, Istoki, 2013, 277 p.

11. Popova Z. D., Sternin I. A. Sememe and Component Analysis as Methods of Semasiology [Sememnyy i semnyy analiz kak metody semasiologii]. Yazyk i natsionalnoe soznanie (Language and National Consciousness), № 12, Voronezh, Istoki, 2009, pp. 4–9.

12. Rozaliev V. L. The Construction of a Model of Emotion by Human Speech [Postroenie modeli emotsiy po rechi cheloveka]. Izvestiya Volgogradskogo gosudarstvennogo tekhnicheskogo universiteta (IzvestiyaVolgogradStateTechnicalUniversity), 2007, Vol. 3, No 9 (35), pp. 65–68.

13. Romanenko R. Yu. Wavelet Analysis of Speech Signals. The Successes of Modern Radioelectronics [Veyvlet-analiz rechevykh signalov. Uspekhi sovremennoy radioelektroniki]. Zarubezhnaya radioelektronika (Foreign Radioelectronics), 2010, № 12, pp. 51–54.

14. Sidorov K. V., Filatov N. N. Analysis of the Signs of Emotionally Colored Speech [Analiz priznakov emotsionalno okrashennoy rechi]. Vestnik Tverskogo gosudarstvennogo tekhnicheskogo universiteta (Bulletin of the TverStateTechnicalUniversity), 2012, № 20, pp. 26–31.

15. Tarasova O. D. Main Trends in the Study of Emotions in Linguistics [Osnovnye napravleniya issledovaniya emotsiy v lingvistike]. Vestnik MGOU. Seriya: Lingvistika (Bulletin MGOU. Series: Linguistics), 2015, № 3, pp. 38–45.

16. Teliya V. N. Connotative Aspect of Semantics of Nominative Units [Konnotativnyy aspekt semantiki nominativnykh edinits]. Moscow, Nauka, 1986, 143 p.

17. Chernigovskaya T. V., Svetozarova N. D., Tokareva T. I., Tretyakov D. A., Ozerskiy P. V., Strelnikov K. N. Specialization of the Cerebral Hemispheres in the Perception of Intonation of the Russian Language [Spetsializatsiya polushariy mozga v vospriyatii intonatsiy russkogo yazyka]. Fiziologiya Cheloveka (Human Physiology), 2000, № 2, pp. 24–29. Available at: http://www.genlingnw.ru/Staff/Chernigo/publicat/FelixFIN.pdf (accessed 01 September 2017).

18. Shakhovskiy V. I. Categorization of Emotions in the Language Lexico-semantic System [Kategorizatsiya emotsiy v leksiko-semanticheskoy sisteme yazyka]. Voronezh, VGU, 1987, 192 p.

19. Shakhovskiy V. I. About Linguistics of Emotions [O lingvistike emotsiy]. Yazyk i emotsii: Sbornik nauchnykh trudov. Volgogradskiy gosudarstvennyy pedagogicheskiy universitet (Language and Emotions: a Collection of Scientific Works. State Pedagogic University). Volgograd, Peremena, 1995, pp. 3–15.

20. Shakhovskiy V. I., Krasavskiy N. A. (Ed.) Emotional / Emotive Competence in Intercultural Communication [Emotsionalnaya / emotivnaya kompetentsiya v mezhkulturnoy kommunikatsii]. Aksiologicheskaya lingvistika: problemy izucheniya kulturnykh kontseptov i etnosoznaniya (Axiological Linguistics: Problems of Study of Cultural Concepts and Ethno-consciousness). Volgograd, 2002, pp. 3–10.

21. Avanzi M., Christodoulides G., Lolive D., Delais-Roussarie E., Barbot N. Towards the Adaptation of Prosodic Models for Expressive Text-To-Speech Synthesis. ISCA 2014, 14–18 September 2014, Singapore. DOI: 10.13140/2.1.4640.3848.

22. Avetisyan H., Bruna O., Holub J. Overview of Existing Algorithms for Emotion Classification. Uncertainties in Evaluations of Accuracies. IMEKO 2016 TC1-TC7-TC13, IOP Publishing, Journal of Physics, Conference Series, 772, 2016. DOI:10.1088/1742-6596/772/1/012039.

23. Baksheeva Yu., Bazanova O., Kostromina S., Nikolenko E., Sapozhnikova K., Taymanov R. Neurophysiological Markers of Tonalities. Ninth Triennial Conference of the European Society for the Cognitive Sciences of Music. Manchester, UK, 2015, pp. 202–203.

24. Bruna O., Avetisyan H., Holub J. Emotion Models for Textual Emotion Classification. IMEKO 2016. TC1-TC7-TC13, IOP Publishing, Journal of Physics, Conference Series, 772, 2016. DOI:10.1088/1742-6596/772/1/012063

25. Rampinini A., Ricciardi E. In Favor of the Phonemic Principle: a Review of Neurophysiological and Neuroimaging Explorations. Studi & Saggi Linguistici, 2017, Vol. 55 (1), pp. 95–123. Available at: https://www.researchgate.net/publication/315657311_In_Favor_of_the_Phonemic_Principle_a_Review_of_Neurophysiological_and_Neuroimaging_Explorations_In_Studi_Saggi_Linguistici_55_1_95-123 (accessed 01 September 2017).

26. Sapozhnikova K., Taymanov R. About a Measuring Model of Emotional Perception of Music. Proceedings of the XVII IMEKO World Congress. Dubrovnik, Croatia, 2003, рр. 2049–2053.

27. Sapozhnikova K., Taymanov R., Baksheeva Yu., Kostromina S., Gnedykh D., Danilova I., Cosimi Corleto (Ed.) Metrological Approach to Measurements of Emotions Being Expected in Response to Acoustic Impacts, Proceedings of the 18th International Congress of Metrology, EDP sciences, Web of Conferences, Paris, France, September 19–21, 2017. Available at: https://cfmetrologie.edpsciences.org/articles/metrology/abs/2017/01/metrology_metr2017_10006/metrology_metr2017_10006.html (accessed 01 September 2017). DOI: https://doi.org/10.1051/metrology/201710006.

28. Taymanov R., Baksheeva Yu., Sapozhnikova K., Chunovkina A. Measurement Model as a Means for Studying the Process of Emotion Origination. Journal of Physics: Conference Series (JPCS). 2016, 6 p. Available at: http://iopscience.iop.org/article/10.1088/1742-6596/772/1/012036 (accessed 01 September 2017). DOI: 10.1088/1742-6596/772/1/012036.

29. Taymanov R, Sapozhnikova K. Improvement of Traceability of Widely-Defined Measurements in the Field of Humanities. Measurement Science Review, 2010, Vol. 10, No 3, pp. 78–88.

30. Taymanov R., Sapozhnikova K. Measurement of Multiparametric Quantities at Perception of Sensory Information by Living Creatures. EPJ Web of Conferences. 2014, Vol. 77. Available at: http://www.epj-conferences.org/articles/epjconf/pdf/2014/14/epjconf_icm2014_00016.pdf. (accessed 01 September 2017). DOI: 10.1051/epjconf/20147700016.

31. Yang H., Meng H. M., Cai L. Modeling the Acoustic Correlates of Expressive Elements in Text Genres for Expressive Text-to-Speech Synthesis. INTERSPEECH 2006 and 9th International Conference on Spoken Language Processing. INTERSPEECH 2006, ICSLP, 4, 2006, pp. 1806–1809.

Ссылка на статью:

Зиновьева Е. И., Кузнецов Ю. А., Шахматова М. А., Бакшеева Ю. В., Данилова И. М., Сапожникова К. В., Тайманов Р. Е. Метрологический подход к распознаванию эмоций в звучащей речи // Философия и гуманитарные науки в информационном обществе. – 2017. – № 3. – С. 63–82. URL: http://fikio.ru/?p=2810.

© Е. И. Зиновьева, Ю. А. Кузнецов, М. А. Шахматова, Ю. В. Бакшеева, И. М. Данилова, К. В. Сапожникова, Р. Е. Тайманов, 2017